Votre contenu peut être “bon” et rester invisible si sa sémantique est mal alignée.

Ici, on vise une efficacité sémantique mesurable : moins d’ambiguïté, des intentions mieux couvertes, des entités mieux reliées, et une architecture qui aide autant les moteurs que les utilisateurs. La démarche ci-dessous est conçue pour passer d’un ressenti éditorial à une méthode reproductible, utilisable en SEO, Knowledge Graph et moteurs de réponse.

Si vous avez besoin d’un point d’appui pour accélérer la production (sans sacrifier la rigueur), vous pouvez compléter ce process avec un générateur de texte IA (à condition d’imposer un cadre sémantique strict).

Table of Contents

TogglePrérequis et préparation

Outils et accès nécessaires

Le socle minimal n’est pas “un outil SEO de plus”, mais un pipeline qui relie contenu, intentions et signaux de performance :

| Besoin | Objectif | Exemples (catégories) |

|---|---|---|

| Inventaire de pages | Mapper le périmètre et éviter les angles morts | Export CMS, crawl, sitemap |

| Logs / Search Console | Comprendre requêtes, pages et couverture d’intentions | GSC, logs serveur, analytics |

| Environnement NLP | Nettoyage + extraction + scoring | Python/R, notebooks, librairies NLP |

| Référentiel sémantique | Stabiliser définitions, entités, règles d’écriture | Glossaire, taxonomie, dictionnaires |

Temps estimé | Niveau de difficulté

Comptez un cycle “audit → extraction → refonte structurelle → QA” sur un échantillon représentatif, puis industrialisez. La difficulté vient moins de l’algorithme que de la discipline : périmètre clair, normes, et validation croisée entre SEO et contenu.

CHECKLIST : Conditions techniques avant de démarrer

| Contrôle | Pourquoi c’est bloquant | Critère de passage |

|---|---|---|

| Textes récupérables proprement | Sans corpus propre, aucune extraction n’est fiable | HTML → texte (boilerplate retiré) + encodage stable |

| Liste canonique des URLs | Évite doublons, cannibalisation et analyses faussées | 1 URL canonique par contenu utile |

| Accès aux performances | Il faut relier sémantique ↔ résultats | GSC/analytics accessibles + périodes cohérentes |

| Règles éditoriales stabilisées | Sinon, la sémantique dérive au fil des rédactions | Guide (terminologie, ton, structure, intertitres) |

| Référence NLP “sérieuse” | Pour éviter les interprétations floues du vocabulaire | Documentation + concepts maîtrisés |

Pour cadrer les notions (syntaxique, sémantique, extraction, etc.), vous pouvez vous appuyer sur la ressource académique du Stanford NLP Group : https://nlp.stanford.edu/.

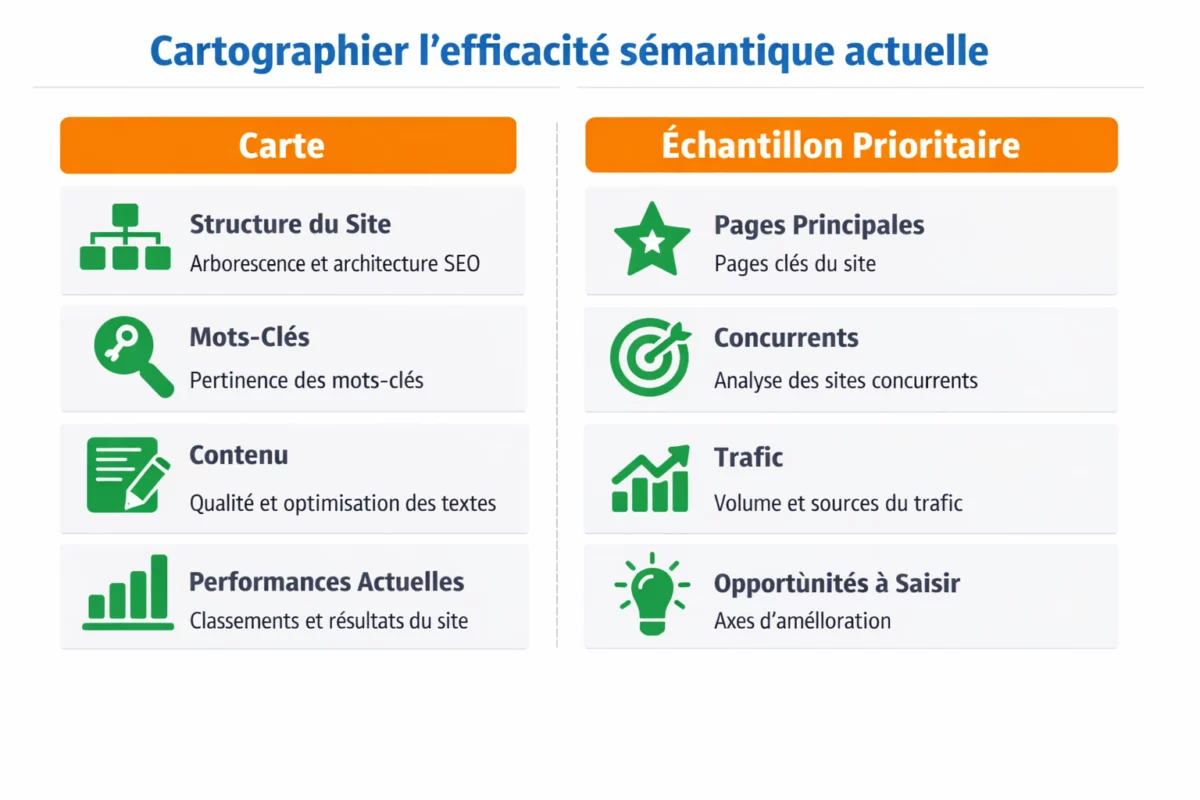

Cartographier l’efficacité sémantique actuelle

Action concrète

Construisez une carte “requêtes → intentions → pages → entités” sur un échantillon prioritaire (vos pages business + vos pages qui drainent déjà du trafic). L’objectif : repérer ce qui est couvert, ce qui est confus, et ce qui manque.

DIAGRAMME : Entités, intents, relations, pages cibles

[Intent A : comparer] ──(déclenche)──> Page P1 (guide) │ │ │ (mentionne) ▼ ▼ [Entité : Produit X] ──(lié à)──> [Entité : Marque Y] │ (alternative) ▼ [Entité : Produit Z] ──(lié à)──> Page P2 (comparatif) [Intent B : résoudre] ──(déclenche)──> Page P3 (FAQ) │ ▼ [Entité : Problème Q] ──(solution)──> [Entité : Méthode R]Retrouvez aussi échantillon prioritaire (vos sur notre site.

Découvrez également notre article sur Transformez vos résultats.

SNIPPET : Gabarit de brief sémantique par page

{

"url": "https://exemple.com/page",

"objectif": "Intention principale + intention(s) secondaire(s)",

"cible": "Profil lecteur + contexte d’usage",

"entites_obligatoires": ["...", "..."],

"entites_a_eviter": ["..."],

"angles": ["définition", "critères", "procédure", "preuves", "limitations"],

"questions_a_traiter": ["...", "...", "..."],

"elements_de_confiance": ["sources", "méthode", "exemples", "cadre"],

"maillage": {

"entrants_attendus": ["..."],

"sortants_attendus": ["..."]

},

"risques": ["hors-sujet", "sur-promesse", "ambiguïtés terminologiques"]

}Interprétation utile : l’efficacité sémantique n’est pas “mettre plus de mots”. C’est réduire la distance entre ce que l’utilisateur veut, ce que la page affirme, et ce que le site prouve via ses liens et sa cohérence.

Nettoyer et normaliser le corpus texte

Action concrète

Avant toute extraction, standardisez le corpus : même format, même règles, même exclusions. C’est ici que vous sécurisez la qualité du signal (et que vous évitez d’entraîner vos analyses sur du bruit : menus, footers, blocs répétés, consent banners, etc.).

Point de vigilance : ne confondez pas normalisation linguistique et uniformisation éditoriale. On nettoie pour analyser, on n’aplatit pas la nuance métier.

DIAGRAMME : Pipeline tokenisation, lemmatisation, NER

HTML pages │ ├─> Extraction texte (boilerplate removal) │ ├─> Nettoyage (encodage, espaces, ponctuation, doublons) │ ├─> Segmentation (phrases / paragraphes) │ ├─> Tokenisation │ ├─> Lemmatisation │ ├─> NER (reconnaissance d’entités nommées) │ └─> Index sémantique (features, embeddings, stats)

À ce stade, documentez précisément vos règles de traitement : ce que vous retirez, ce que vous gardez, et pourquoi. En production, c’est un sujet de gestion autant que de technique.

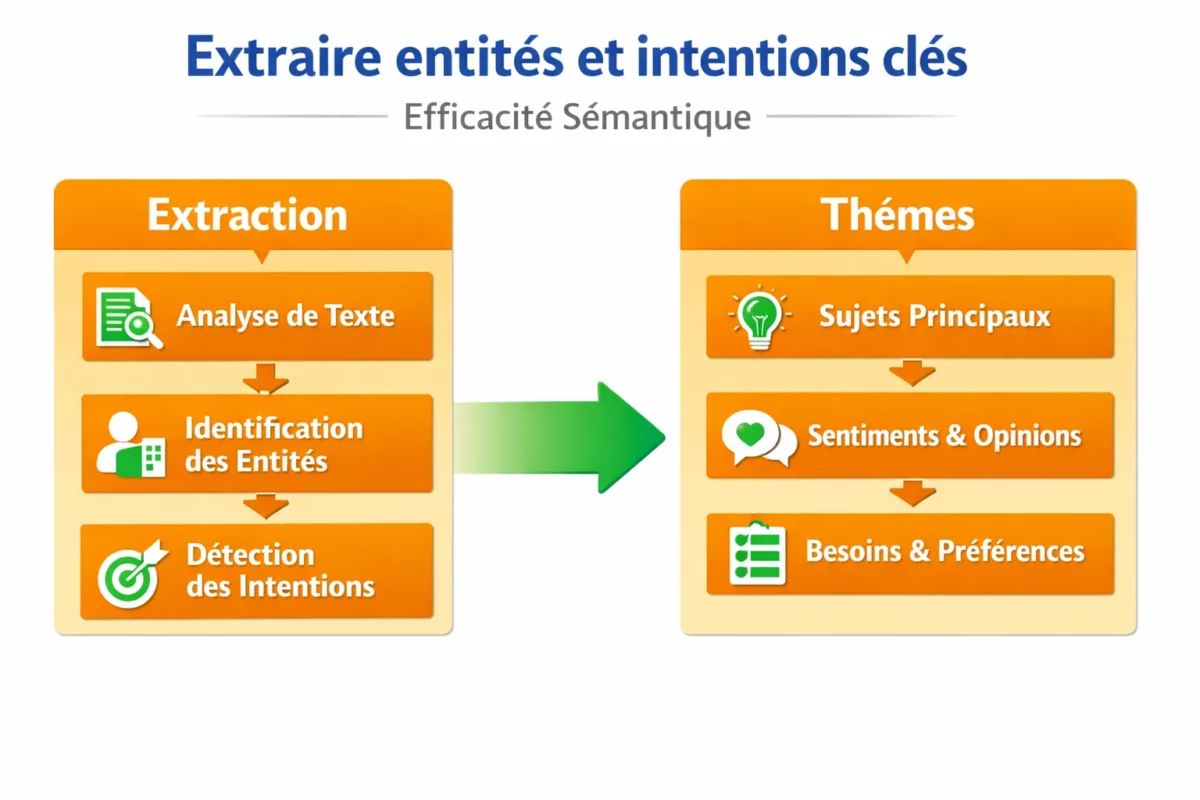

Extraire entités et intentions clés

Action concrète

Exécutez une extraction en deux couches :

| Couche | But | Résultat attendu |

|---|---|---|

| Extraction “large” | Détecter les thèmes, variants, cooccurrences | Liste candidate d’entités + signaux de contexte |

| Extraction “contrôlée” | Stabiliser les entités utiles au business et au SEO | Référentiel d’entités normalisées + règles |

Point de vigilance

La précision chute vite si vous ne gérez pas : homonymie, entités tronquées, ou entités “parasites” (trop génériques). C’est pourquoi une phase d’annotation (même légère) sur un échantillon est souvent rentable, et peut être internalisée ou confiée à des services annotation lorsque les volumes ou la complexité augmentent.

SNIPPET : Format de sortie entités, attributs, synonymes

[

{

"entite": "Nom normalisé",

"type": "Produit|Service|Concept|Organisation|Lieu|Personne",

"synonymes": ["variante A", "variante B"],

"attributs": {

"proprietes": ["..."],

"contraintes": ["..."],

"signaux_de_confiance": ["citation", "preuve", "exemple"]

},

"intentions_associees": ["comprendre", "comparer", "choisir", "résoudre"],

"pages_cibles": [

{"url": "https://exemple.com/page-1", "role": "pivot|support|faq"}

],

"notes": "règles de rédaction, exclusions, ambigüités"

}

]Choisissez un modèle nlp adapté à votre langue, votre domaine et votre niveau d’exigence. Sur des contenus métiers (B2B, médical, juridique, catalogues), la “bonne” approche est souvent hybride : règles + apprentissage + validation humaine. C’est du travail d’ingénierie de sens, pas un bouton magique.

Structurer contenus et maillage interne

Action concrète

Transformez vos résultats NLP en architecture éditoriale : clusters thématiques, pages pivots, pages supports, FAQ, et liens internes alignés sur les intentions. Le but : que chaque page ait un rôle explicite et que le site “raconte la même vérité” à toutes les échelles (page, cluster, domaine).

Point de vigilance : ne construisez pas des clusters uniquement “par mots”. Un cluster doit répondre à un ensemble d’intentions cohérentes et faire circuler la preuve (exemples, définitions, critères, limites). C’est particulièrement critique en e-commerce et pour les retailers, où la sémantique doit rester stable entre catégories, filtres et fiches.

DIAGRAMME : Clusters thématiques et pages pivots

[Page Pivot : Guide A] / | / | [Support A1] [Support A2] [FAQ A3] | | | (preuve) (comparatif) (objections) [Page Pivot : Guide B] / | [Support B1] [Support B2] Règle : liens = intention → page la plus utile → preuve → approfondissement

Impliquez les équipes data science si vous industrialisez sur beaucoup de pages, plusieurs langues, ou plusieurs gammes de produits. Le passage à l’échelle se gagne sur l’outillage et la gouvernance, pas sur des ajustements au cas par cas.

Validation et résultats

Comment vérifier que ça marche

Validez à trois niveaux, du plus “sémantique” au plus “business” :

| Niveau | Ce que vous vérifiez | Ce que vous cherchez |

|---|---|---|

| Couverture | Intentions et entités critiques présentes, non ambiguës | Moins de trous de contenu, moins de pages “inclassables” |

| Coopération intra-site | Maillage, cohérence terminologique, rôles des pages | Moins de cannibalisation, meilleure circulation |

| Performance | Alignement requêtes ↔ pages ↔ satisfaction | Gains qualitatifs : CTR, engagement, conversions, stabilité |

MATRICE : Problèmes fréquents → Solutions

| Symptôme | Cause probable | Solution sémantique |

|---|---|---|

| La page attire mais ne convainc pas | Intention mal identifiée (information vs action) | Réécrire l’angle, ajouter preuves, clarifier le “job to be done” |

| Cannibalisation entre 2 pages | Mêmes entités + mêmes intentions | Définir une page pivot, spécialiser l’autre, renforcer liens et différenciation |

| Entités incohérentes d’une page à l’autre | Pas de référentiel, variantes non contrôlées | Normaliser, imposer synonymes/termes préférés, créer un glossaire |

| Extraction trop “bruitée” | Corpus sale, NER mal calibrée | Revoir nettoyage, ajouter règles, échantillon annoté, itérer |

| Pages “hors-sujet” malgré un bon texte | Maillage et contexte sémantique faibles | Repenser cluster, renforcer pages supports, améliorer ancres et voisinage |

SNIPPET : Checklist QA sémantique avant publication

QA_En pratique, les meilleurs résultats viennent d’une boucle courte : extraction → ajustements → revalidation, plutôt que d’un “grand chantier” figé. Sur des projets multi-équipes, formalisez vos décisions (quoi, pourquoi, quand) pour éviter la dérive sémantique.

FAQ performance sémantique

Quelle différence entre NLP classique et LLM ?

Le NLP “classique” vise souvent des tâches ciblées (classification, NER, similarité) avec des règles et/ou des modèles supervisés. Les LLM excellent en génération et compréhension contextuelle, mais peuvent inventer ou lisser des nuances. Pour l’efficacité sémantique, le meilleur combo est fréquemment : extraction contrôlée (NLP) + rédaction assistée (LLM) + validation.

Quels signaux prouvent une meilleure pertinence sémantique ?

Les signaux les plus convaincants sont cohérents entre eux : requêtes plus alignées sur la page, meilleure stabilité du positionnement sur des variantes, amélioration du CTR sur des SERP comparables, baisse des retours rapides vers les résultats, et maillage interne qui distribue mieux l’autorité au sein des clusters.

Comment éviter la sur-optimisation et le hors-sujet ?

Fixez un référentiel (entités prioritaires, exclusions, angles autorisés), puis évaluez chaque ajout avec une question simple : “Est-ce que cela aide l’utilisateur à décider/comprendre/résoudre ?”. La sémantique utile est orientée preuves et critères, pas accumulation de termes.

Quels volumes de données pour des résultats fiables ?

Commencez petit mais représentatif : un échantillon de pages qui couvrent les intentions clés. Ensuite, élargissez par cluster. La fiabilité vient surtout de la propreté du corpus, de règles stables, et d’une validation humaine sur des cas limites, plus que d’un volume “massif” de textes.

Que faire si les entités extraites sont bruitées ?

Traitez le problème dans l’ordre : (1) corpus (nettoyage), (2) règles (exclusions, patterns), (3) calibration du modèle, (4) mini-jeu annoté pour corriger les erreurs récurrentes. Le bruit est normal au début : l’objectif est de le rendre prévisible et corrigeable.

Synthèse

Points clés à retenir

L’efficacité sémantique se construit quand vos contenus (a) couvrent les bonnes intentions, (b) utilisent des entités normalisées, (c) explicitent les relations, et (d) s’assemblent en clusters navigables et cohérents. C’est autant un sujet de méthode que de NLP.

Prochaines actions prioritaires

Faites un audit sur un cluster prioritaire, normalisez le corpus, extrayez et stabilisez votre référentiel d’entités, puis restructurez le maillage autour de pages pivots. Documentez vos décisions pour maintenir la cohérence dans l’entreprise (SEO, contenu, produit).

Indicateurs de suivi à maintenir dans le temps

Surveillez l’évolution des intentions couvertes, la cohérence terminologique, la dispersion des pages sur les mêmes requêtes, et les retours utilisateurs. L’objectif n’est pas seulement de “ranker”, mais de rester pertinent quand le langage, les SERP et les usages changent.

Phrase de fin : Traitez la sémantique comme un système : référentiel, contenu, liens, et validation — sinon elle se dégrade silencieusement.

Eric Ibanez

Co-fondateur de Hack The SEO

Eric Ibanez a créé Hack The SEO et accompagne des stratégies SEO orientées croissance. Il est aussi co-auteur du livre SEO pour booster sa croissance, publié chez Dunod.

Suggested Articles